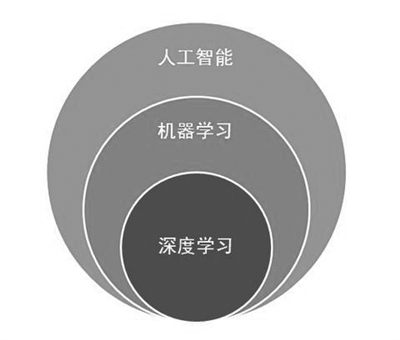

人類一直夢想讓機(jī)器擁有我們?nèi)祟惔竽X一樣的思維能力,而近年來深度學(xué)習(xí)在人工智能領(lǐng)域的表現(xiàn)一枝獨秀。人工智能有兩個主要分支:符號主義和聯(lián)接主義。前者通過代號描繪萬物,然后通過句法分析和謂詞演算實現(xiàn)邏輯推理;聯(lián)接主義則模擬人腦的神經(jīng)元聯(lián)接,通過學(xué)習(xí)形成輸入和輸出之間的映射。大體上講,上世紀(jì)80年代之前,人工智能以符號主義的規(guī)則系統(tǒng)為主流,之后聯(lián)接主義的(人工)神經(jīng)網(wǎng)絡(luò)漸漸成為人工智能的代名詞,其中的原因更多的是利用數(shù)學(xué)工具分析和優(yōu)化網(wǎng)絡(luò)。深度學(xué)習(xí)則是近年來被廣泛實際應(yīng)用的神經(jīng)網(wǎng)絡(luò)。

由于人工智能領(lǐng)域中的反向傳播算法取得了突破性進(jìn)展,第一個卷積神經(jīng)網(wǎng)絡(luò)——時間延遲網(wǎng)絡(luò)應(yīng)運而生。時間延遲網(wǎng)絡(luò)是一個應(yīng)用于語音識別任務(wù)的卷積神經(jīng)網(wǎng)絡(luò),使用離散傅氏變換的快速算法預(yù)處理的語音信號作為輸入,其隱含層由兩個一維卷積核組成,以提取頻率域上的平移不變特征。紐約大學(xué)終身教授樂昆(LeCun)在1989 年構(gòu)建了應(yīng)用于圖像分類的卷積神經(jīng)網(wǎng)絡(luò)。卷積神經(jīng)網(wǎng)絡(luò)對權(quán)重進(jìn)行隨機(jī)初始化后,使用了隨機(jī)梯度下降算法進(jìn)行學(xué)習(xí),這一策略在隨后的深度學(xué)習(xí)研究中被廣泛采用。此外,樂昆在論述其網(wǎng)絡(luò)結(jié)構(gòu)時首次使用了“卷積”一詞,“卷積神經(jīng)網(wǎng)絡(luò)”也因此而得名。

2006年后,隨著深度學(xué)習(xí)理論的完善,尤其是逐層學(xué)習(xí)和參數(shù)微調(diào)技術(shù)的出現(xiàn),卷積神經(jīng)網(wǎng)絡(luò)開始快速發(fā)展,在結(jié)構(gòu)上不斷加深,各類學(xué)習(xí)和優(yōu)化理論得到引入。2012 年,多倫多大學(xué)杰弗里·辛頓帶領(lǐng)的團(tuán)隊結(jié)合前人的研究工作提出了新的卷積網(wǎng)絡(luò),采用數(shù)據(jù)增強(qiáng)、小批量隨機(jī)梯度下降等作為激活函數(shù)和使用圖形處理器(GPU)加速計算等特點,大大提升圖像分類和物體識別的正確率。

從技術(shù)角度上講,神經(jīng)網(wǎng)絡(luò)完成從數(shù)據(jù)到概念的任務(wù)學(xué)習(xí),比如,輸入的數(shù)據(jù)是一幅圖像,輸出是“牛”“馬”等概念。當(dāng)然,直接從聲音或圖像數(shù)據(jù)得到這些概念的映射不太可能,需要從這些原始的聲音或圖像數(shù)據(jù)中抽取特征,比如,邊沿、基函數(shù)序列等。

傳統(tǒng)神經(jīng)網(wǎng)絡(luò)利用各種數(shù)學(xué)工具,如傅里葉變換、正交變換等方法從原始數(shù)據(jù)中抽取特征,這種方式的弊端在于我們并不能確定哪種數(shù)學(xué)工具能得到最好的特征。隨著GPU的發(fā)展,計算機(jī)學(xué)家們拋棄了這些數(shù)學(xué)方法提取特征,以最簡單的比對與組合方式,完成特征抽取。這種方式雖然“簡單粗暴”,但由于GPU的強(qiáng)大計算能力,確實能找到更好的特征表示,并且實現(xiàn)神經(jīng)網(wǎng)絡(luò)的“端到端”學(xué)習(xí),即像人腦一樣黑箱式工作——人可以很聰明,但我們不需要知道人腦內(nèi)部如何工作。

以卷積神經(jīng)網(wǎng)絡(luò)為代表的深度學(xué)習(xí)是傳統(tǒng)神經(jīng)網(wǎng)絡(luò)的延伸,只是利用GPU的強(qiáng)大計算能力,以大樣本訓(xùn)練的方式自動提取特征,因為其高度非線性表達(dá)能力已被廣泛應(yīng)用到很多領(lǐng)域,但存在諸多問題,在實際生產(chǎn)環(huán)境中極少存在大規(guī)模滿足訓(xùn)練要求的數(shù)據(jù)集;網(wǎng)絡(luò)的訓(xùn)練和運行沒有嚴(yán)格遵照仿生學(xué)原理,這也是其性能得不到進(jìn)一步優(yōu)化的瓶頸問題。所以說,深度學(xué)習(xí)不能成為人工智能的途徑。

因此,在人工智能與深度學(xué)習(xí)正在進(jìn)入實用階段的關(guān)鍵時刻,亟需對深度學(xué)習(xí)有一個清醒認(rèn)識,秉承仿生學(xué)原理,通過少量模式而不是大量樣本來實現(xiàn)特征的提取。

(作者系深圳大學(xué)計算機(jī)與軟件工程學(xué)院教授)

【免責(zé)聲明】本文轉(zhuǎn)載自網(wǎng)絡(luò),與科技網(wǎng)無關(guān)。科技網(wǎng)站對文中陳述、觀點判斷保持中立,不對所包含內(nèi)容的準(zhǔn)確性、可靠性或完整性提供任何明示或暗示的保證。請讀者僅作參考,并請自行承擔(dān)全部責(zé)任。